ibotの無駄なところを削げ落とし、mobileにも対応したものにしたい。今のシステムを変えようとしたがうまくいかない。最初から作り直したほうがいい。時間かかるが仕方がない。

月別: 2016年12月

人工知能のインターフェイスとしてのロボット

ロボットに一つのお笑い芸をさせたい。

具体的には、即興的に与えられた大喜利のお題に答えるというものだ。お題に対して答えるのは、人工知能的にやらせれば良い、答えをコンピュータから出すのではなく、ロボットにさせた方が、人は答えを受け止めやすい。

ロボットは、インターフェイスとなるのだ。

大喜利の答えを集めて、人工知能の教育材料とするためのサイトを作成した。

http://aicomedian.com(その後中止)

どなたでも、遠慮なく、ぜひ試していただきたい。

ibotをバージョンアップする

一つ大きな仕事があって、安定したibotシステムで対応しなければならなかったので、本格的な変更を全くしなかった。それが終わって、これからもっといいシステムにする。当面の改良すべき点は、

(1)複数ロボットを扱っている時Qimessaging.jsからsessionオブジェクトを、毎回作り直していたが、これが無駄なので、sessionを連想配列の中に入れて、使い回せるようにする。

(2)telepathyがやはり不安定なので、現在のような複数ロボットの起動時に、他のすべてのロボットの状態をすべて認識するというのはそのままに生かして、それをたとえやらなくても、あるいは既にやっていたとしても、ibotクライアント側が持っているすべてのロボット情報を事後的にロボットに送り込んで、telepathy通信に用いられるようにする。

さらに抜本的には、先に書いたロボットの聞いた言葉をクライアント側で、文字列に起こして人工知能的処理ができるようにしたい。

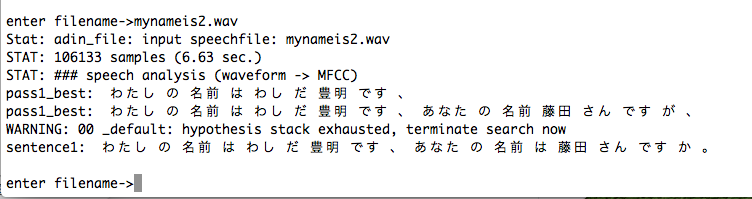

Juliusにwav音声ファイルをテキスト化させる

音声認識でweb speech api を使う

今日考えていたことをメモがわりに書いておこう。

(1)ロボットNAOが受け取った人の言葉を音声ファイルに出力することは制御できるだろう。C++でライブラリ化することができる。

(2)そのファイルをPC、つまりMACbookに、無線ネットワーク経由で送ることもできる。

(3)MacでChromeを開いていて、ibotサイトを表示しているとすると、Chromeのweb speech api が使えるだろう。

(4)受け取った音声ファイルをJAVAで、実際の音として出力することはできるだろう。

(5)その音を、物理的コードを使って、マイク入力として直接入力することができるだろう。

(6)その入力に反応して、音声をweb speech apiがテキスト化することができるだろう。

(7)javascriptからjavaを呼びだして、そのテキストを、JAVAで解析して、求める答えを構成させることができたとする。

(8)それをロボットに送り込み、qichatの変数に組み込み、それを読み出させるイベントを発生させることができるだろう。

(9)ロボットは、その内容を喋るだろう。

※PCはインターネットに接続していなければならない。

以上